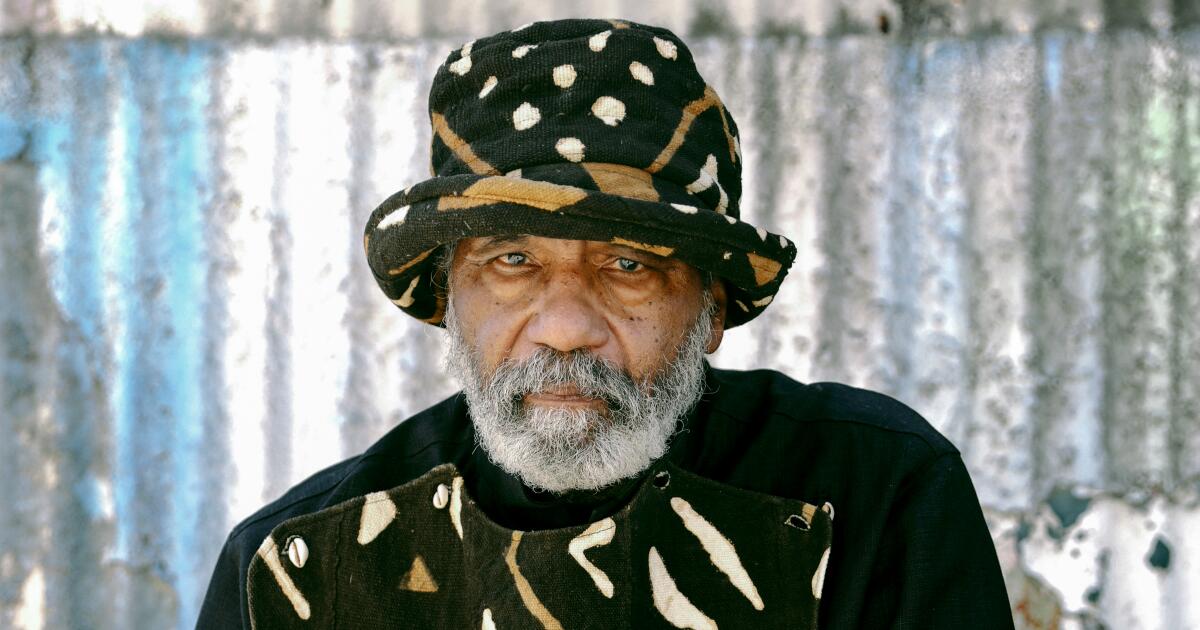

- Nvidia erwirbt SchedMD, um Slurm als Open-Source-Workload-Management-Software weiterzuführen

- Slurm verwaltet die Planung und Ressourcen für große Cluster, die parallele KI-Aufgaben ausführen

- Nvidia hat Nemotron 3-Modelle in den Größen Nano, Super und Ultra für KI-Aufgaben auf den Markt gebracht

Nvidia hat eine erhebliche Ausweitung seiner Open-Source-Bemühungen angekündigt und eine Software-Übernahme mit neuen offenen KI-Modellen kombiniert.

Das hat das Unternehmen angekündigt SchedMD erworbender Entwickler von Slurm, an Open Source Workload-Management-System, das im Hochleistungsrechnen und in der KI weit verbreitet ist.

Nvidia wird Slurm weiterhin als herstellerneutrale Software betreiben, um die Kompatibilität mit unterschiedlicher Hardware sicherzustellen und den Support für bestehende HPC- und KI-Kunden aufrechtzuerhalten.

Slurm und mehr

Slurm verwaltet die Planung, Warteschlangenbildung und Ressourcenzuweisung über große Computercluster hinweg, die parallele Aufgaben ausführen.

Mehr als die Hälfte der in der TOP500-Rangliste aufgeführten Top-10- und Top-100-Supercomputer verlassen sich auf die Dienste, wobei Unternehmen, Cloud-Anbieter, Forschungslabore und KI-Unternehmen aus allen Branchen das System nutzen, darunter Organisationen aus den Bereichen autonomes Fahren, Gesundheitswesen, Energie, Finanzdienstleistungen, Fertigung und Regierung.

Slurm arbeitet mit der neuesten Hardware von Nvidia und wird von seinen Entwicklern weiterhin für leistungsstarke KI-Workloads angepasst.

Parallel zur Übernahme führte Nvidia auch das ein Nemotron 3-Familie offener Modelleeinschließlich Nano-, Super- und Ultra-Größen.

Die Modelle nutzen eine hybride Expertenarchitektur zur Unterstützung von KI-Systemen mit mehreren Agenten.

Nemotron 3 Nano konzentriert sich auf die effiziente Aufgabenausführung, Nemotron 3 Super unterstützt die Zusammenarbeit mehrerer KI-Agenten und Nemotron 3 Ultra verarbeitet komplexe Argumentationsworkflows.

Nvidia stellt diese Modelle mit zugehörigen Datensätzen, Reinforcement-Learning-Bibliotheken und NeMo Gym-Trainingsumgebungen bereit.

Nemotron 3-Modelle laufen auf beschleunigten Rechenplattformen von Nvidia, einschließlich Arbeitsplätze und große KI-Cluster.

Entwickler können offene Modelle mit proprietären Systemen in Multi-Agent-Workflows kombinieren und dabei öffentliche Clouds oder Unternehmensplattformen nutzen.

Nvidia stellt Tools, Bibliotheken und Datensätze zur Unterstützung von Schulung, Evaluierung und Bereitstellung in verschiedenen Computerumgebungen bereit.

Nvidia hat drei Billionen Token an Pre-Training-, Post-Training- und Reinforcement-Learning-Daten für Nemotron 3-Modelle veröffentlicht.

Zusätzlich KI-Toolseinschließlich NeMo RL und NeMo Evaluator, bieten Modellbewertung und Sicherheitsbewertung.

Zu den ersten Anwendern, die Nemotron 3 integrieren, gehören Unternehmen aus den Bereichen Software, Cybersicherheit, Medien, Fertigung und Cloud-Dienste.

Nvidia hat Open-Source-Modelle, KI-Tools und Datensätze auf GitHub und Hugging Face für Entwickler bereitgestellt, die Agenten-KI-Anwendungen erstellen.

„Offene Innovation ist die Grundlage des KI-Fortschritts“, schrieb Jensen Huang, Gründer und CEO von Nvidia, in der Pressemitteilung des Unternehmens.

„Mit Nemotron verwandeln wir fortschrittliche KI in eine offene Plattform, die Entwicklern die Transparenz und Effizienz bietet, die sie zum Aufbau skalierbarer Agentensysteme benötigen.“

Folgen Sie TechRadar auf Google News Und Fügen Sie uns als bevorzugte Quelle hinzu um unsere Expertennachrichten, Rezensionen und Meinungen in Ihren Feeds zu erhalten. Klicken Sie unbedingt auf die Schaltfläche „Folgen“!

Und natürlich können Sie das auch Folgen Sie TechRadar auf TikTok für Neuigkeiten, Rezensionen, Unboxings in Videoform und erhalten Sie regelmäßige Updates von uns WhatsApp zu.