Die physische KI hat den Proof-of-Concept hinter sich gelassen. Große Modelle, bessere Simulationen und schnellere Hardware haben die verkörperte Intelligenz vorangetrieben – aber die Manipulation in der realen Welt ist immer noch der limitierende Faktor.

Nicht Wahrnehmung.

Keine Planung.

Manipulation.

Roboter können die Welt immer klarer sehen, haben aber immer noch Schwierigkeiten, zuverlässig mit ihr zu interagieren. Der Grund ist einfach: Nur-Vision-Systeme erfahren keinen Kontakt. Und ohne Kontakt bleibt das Lernen stehen.

Physische KI ist wichtig, weil sie diese Lücke schließt. Es verbindet Wahrnehmung, Entscheidungsfindung und Handeln in der realen Welt – wo Objekte verrutschen, sich verformen, kollidieren und sich auf eine Weise verhalten, die die Simulation noch nicht vollständig erfassen kann.

Touch ist nicht mehr optional. Es ist das fehlende Signal.

Physische KI ist keine traditionelle Automatisierung mit einem aufgeschraubten neuronalen Netzwerk. Es ist ein Wandel in der Art und Weise, wie Roboter lernen und funktionieren.

Anstatt vordefinierte Flugbahnen auszuführen, führen physische KI-Systeme Folgendes aus:

- Nehmen Sie die Welt anhand verschiedener Daten wahr – Sehen, Fühlen, Propriozeption und Kraft

- Passen Sie das Verhalten während der Interaktion dynamisch an

- Lernen Sie aus realen Ergebnissen und nicht aus Skript-Erfolgsfällen

Dies ist im Moment des Kontakts am wichtigsten – wenn die Finger auf einen Gegenstand treffen, wenn sich die Kraft ungleichmäßig verteilt, wenn das Gleiten beginnt.

Diese Millisekunden bestimmen, ob ein Griff erfolgreich ist, fehlschlägt oder verwertbare Trainingsdaten generiert.

Ohne taktiles Feedback raten Roboter. Damit lernen sie.

Die traditionelle Automatisierung wurde auf Wiederholbarkeit ausgelegt. Bekannte Objekte. Bekannte Posen. Bekannte Kräfte.

Dieses Modell bricht zusammen, wenn:

- Objekte variieren in Form, Steifigkeit oder Oberfläche

- Die Kontaktdynamik ist nichtlinear

- Der Aufgabenbereich ist groß und begrenzt

Um dies zu kompensieren, fügen Teams im Vorfeld häufig zusätzliche Komplexität hinzu: engere Vorrichtungen, eingeschränkte Umgebungen oder maßgeschneiderte Endeffektoren, die für enge Aufgaben entwickelt wurden.

Physische KI stellt diese Gleichung um.

Anstatt die Welt für den Roboter zu vereinfachen, versetzt es den Roboter in die Lage, mit der Welt so umzugehen, wie sie ist.

Das erfordert:

- Kontakterkennung in Echtzeit

- Kontinuierliches Force-Feedback

- Die Fähigkeit, sich nach einem teilweisen Ausfall wiederherzustellen, anstatt ihn zurückzusetzen

Das Ergebnis ist nicht nur ein höherer Aufgabenerfolg. Es sind Systeme, die aus jeder Interaktion (Erfolg oder Misserfolg) lernen und mit der Zeit leistungsfähiger werden.

Das Sehvermögen zeichnet sich durch Argumentation vor dem Kontakt aus: Objekterkennung, Posenschätzung, Szenenverständnis. Aber sobald es zu einem Kontakt kommt, verlangsamt sich das Sehvermögen.

Die Okklusion nimmt zu.

Beleuchtung ändert sich.

Mikrorutsche und Berührungen sind unsichtbar.

Hier scheitern viele Manipulationspipelines – nicht weil das Modell falsch ist, sondern weil es im kritischsten Moment blind ist.

Taktile Wahrnehmung liefert Signale, die das Sehen nicht kann:

- Kontaktgeometrie

- Kraftverteilung

- Rutschbeginn

- Objektkonformität

Für physische KI-Teams geht es hier nicht um schrittweise Verbesserungen. Es geht darum, Lernsysteme freizuschalten, die zuvor instabil, datenarm oder zu kostspielig für die Skalierung waren.

Digitale KI vs. physische KI in Robotikprogrammen

Digitale KI hat die Robotikentwicklung bereits verändert:

- Schnellere Simulation

- Bessere Planung

- Verbessertes Modelltraining und -bewertung

Doch die digitale KI operiert einen Schritt von der Realität entfernt.

Bei der physischen KI werden Modelle einem Belastungstest gegen Physik, Reibung, Rauschen und Unsicherheit unterzogen. Hier werden Lücken zwischen der Simulation und der Realität aufgedeckt – und geschlossen.

Digitale KI hilft bei der Entscheidung, was sollen passieren.

Die physische KI bestimmt was Genau genommen passiert.

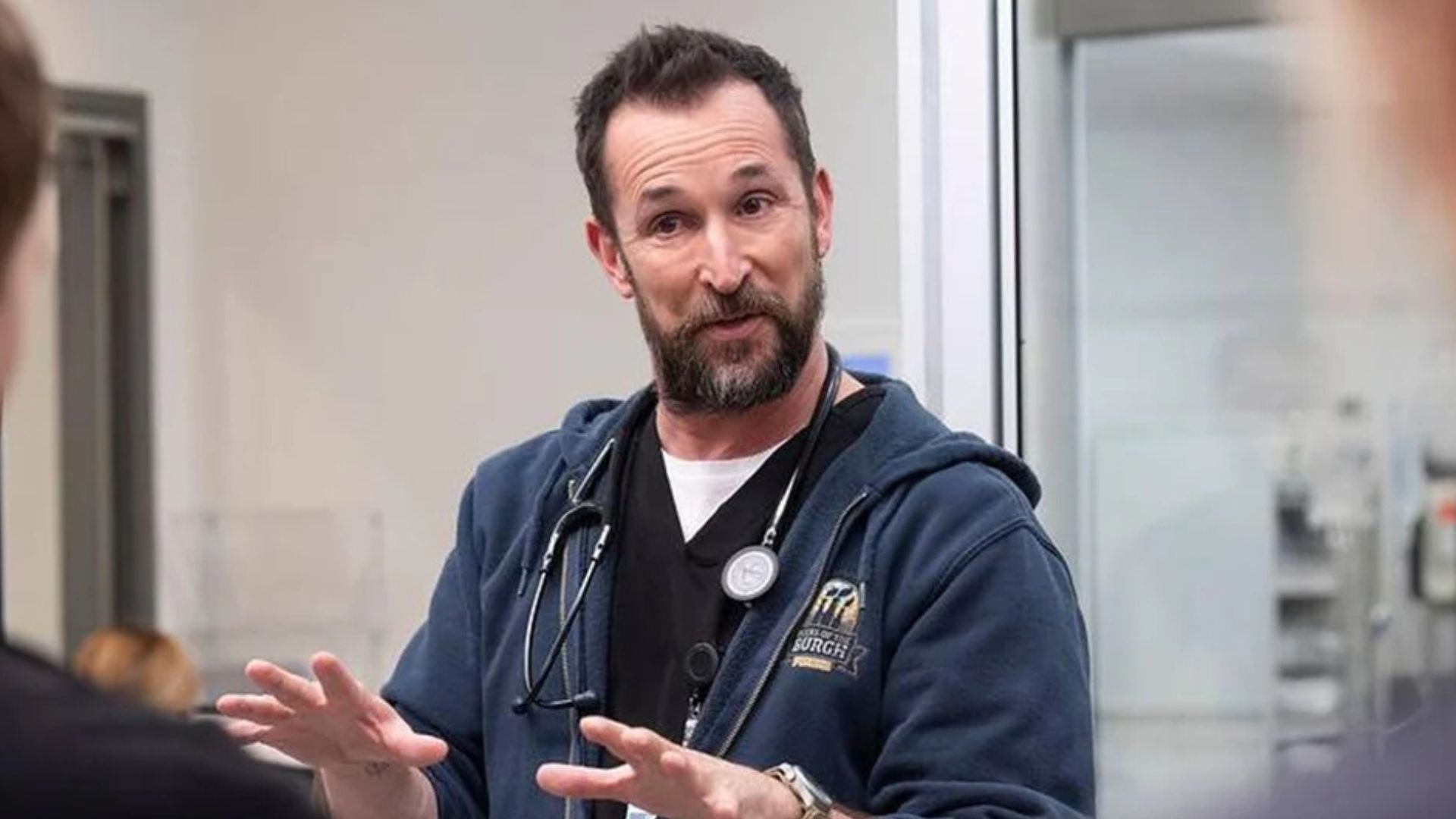

Die physische KI steht vor einer Herausforderung, die die digitale nicht hat: qualitativ hochwertige Daten aus der realen Welt.

Mit der Vergrößerung der Flotten ergeben sich neue Einschränkungen:

- Kosten pro Roboter

- Kosten pro Datenpunkt

- Zuverlässigkeit über Hunderte identischer Stationen hinweg

Kundenspezifische Greifer und maßgeschneiderte taktile Lösungen stellen oft einen Engpass dar. Sie fragmentieren Systeme, verlangsamen die Bereitstellung und lenken den technischen Aufwand von der Kernarbeit der KI ab.

Ein flottentaugliches Manipulationssystem bewirkt das Gegenteil:

- Stationsübergreifende standardisierte Hardware

- Erhöhte Betriebszeit

- Reduzierte Wartungskosten und -zeit

- Bekannte Leistungsumschläge

- Wiederholbare Dateneigenschaften

Das Hinzufügen taktiler Fingerspitzen zu bewährten Industriegreifern verschiebt den Kompromiss. Teams erhalten Zugriff auf umfangreiche Kontaktdaten, ohne die Kosten, die Fragilität und den Wartungsaufwand vollständig benutzerdefinierter Hände in Kauf nehmen zu müssen.

Bei der physischen KI geht es nicht darum, die menschlichste Hand zu bauen. Es geht darum, Systeme zu bauen, die das können Lernen Sie zuverlässig in der realen Welt.

Berührung ermöglicht dieses Lernen.

Konsistenz ermöglicht Skalierung.

Robuste Hardware ermöglicht beides.

Da physische KI-Programme von isolierten Demos zu Flotten übergehen, stellt sich die Frage nicht mehr Kann dieser Roboter einen Gegenstand greifen?

An diesem Punkt hört die taktile Manipulation auf, ein Forschungsmerkmal zu sein – und wird zur Infrastruktur.