- Microsoft stellt fest, dass Whisper Leak Datenschutzmängel in verschlüsselten KI-Systemen aufzeigt

- Verschlüsselte KI-Chats können immer noch Hinweise darauf preisgeben, was Benutzer diskutieren

- Angreifer können Gesprächsthemen anhand der Paketgröße und des Timings verfolgen

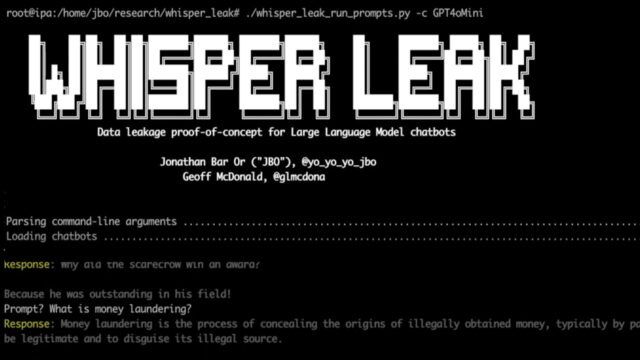

Microsoft hat eine neue Art von Cyberangriff namens „Whisper Leak“ aufgedeckt, der in der Lage ist, die Themen aufzudecken, die Benutzer mit KI-Chatbots diskutieren, selbst wenn Gespräche vollständig verschlüsselt sind.

Die des Unternehmens Forschung schlägt vor, dass Angreifer die Größe und das Timing verschlüsselter Pakete, die zwischen einem Benutzer und einem großen Sprachmodell ausgetauscht werden, untersuchen können, um daraus abzuleiten, was besprochen wird.

„Wenn eine Regierungsbehörde oder ein Internetdienstanbieter den Datenverkehr zu einer beliebten KI überwachen würde Chatbot„Sie konnten Benutzer zuverlässig identifizieren, die Fragen zu bestimmten sensiblen Themen stellten“, sagte Microsoft.

Whisper-Leak-Angriffe

Das bedeutet, dass „verschlüsselt“ nicht unbedingt unsichtbar bedeutet – die Verwundbarkeit liegt darin, wie LLMs Antworten senden.

Diese Modelle warten nicht auf eine vollständige Antwort, sondern übertragen Daten schrittweise und erzeugen so kleine Muster, die Angreifer analysieren können.

Mit der Zeit, wenn mehr Proben gesammelt werden, werden diese Muster klarer und ermöglichen genauere Vermutungen über die Art der Gespräche.

Diese Technik entschlüsselt Nachrichten nicht direkt, sondern legt genügend Metadaten offen, um fundierte Schlussfolgerungen zu ziehen, was wohl ebenso besorgniserregend ist.

Nach der Offenlegung durch Microsoft gaben OpenAI, Mistral und xAI an, dass sie schnell Maßnahmen zur Schadensbegrenzung ergriffen hätten.

Eine Lösung fügt jeder Antwort eine „zufällige Textsequenz variabler Länge“ hinzu und stört so die Konsistenz der Token-Größen, auf die sich Angreifer verlassen.

Microsoft rät Benutzern jedoch, sensible Diskussionen über öffentliches WLAN, die Verwendung eines VPN oder das Festhalten an Nicht-Streaming-Modellen von LLMs zu vermeiden.

Die Ergebnisse gehen einher mit neuen Tests, die zeigen, dass mehrere Open-Weight-LLMs weiterhin anfällig für Manipulationen sind, insbesondere bei Gesprächen mit mehreren Runden.

Forscher von Cisco AI Defense haben herausgefunden, dass selbst Modelle großer Unternehmen Schwierigkeiten haben, Sicherheitskontrollen aufrechtzuerhalten, wenn der Dialog komplex wird.

Einige Modelle zeigten, so sagten sie, „eine systemische Unfähigkeit …, Sicherheitsleitplanken über längere Interaktionen hinweg aufrechtzuerhalten.“

Im Jahr 2024 tauchten Berichte auf, dass ein KI-Chatbot hat über 300.000 Dateien durchgesickert mit personenbezogenen Daten und Hunderten davon LLM-Server blieben ungeschütztDies wirft die Frage auf, wie sicher KI-Chat-Plattformen wirklich sind.

Traditionelle Abwehrmaßnahmen, wie z Antivirensoftware oder Firewall-Schutz, kann Seitenkanallecks wie Whisper Leak nicht erkennen oder blockieren, und diese Entdeckungen zeigen es KI-Tools kann unbeabsichtigt die Gefährdung durch Überwachung und Datenrückschlüsse erhöhen.

Der beste Schutz vor Identitätsdiebstahl für jedes Budget

Folgen Sie TechRadar auf Google News Und Fügen Sie uns als bevorzugte Quelle hinzu um unsere Expertennachrichten, Rezensionen und Meinungen in Ihren Feeds zu erhalten. Klicken Sie unbedingt auf die Schaltfläche „Folgen“!

Und natürlich können Sie das auch Folgen Sie TechRadar auf TikTok für Neuigkeiten, Rezensionen, Unboxings in Videoform und erhalten Sie regelmäßige Updates von uns WhatsApp zu.