- Meta und Nvidia starten mehrjährige Partnerschaft für Hyperscale-KI-Infrastruktur

- Millionen von Nvidias GPUs und Arm-basierten CPUs werden extreme Arbeitslasten bewältigen

- Die einheitliche Architektur umfasst Rechenzentren und Bereitstellungen von Nvidia-Cloud-Partnern

Meta hat eine mehrjährige Partnerschaft mit angekündigt Nvidia Ziel ist der Aufbau einer Hyperscale-KI-Infrastruktur, die in der Lage ist, einige der größten Arbeitslasten im Technologiesektor zu bewältigen.

Diese Zusammenarbeit wird Millionen von Menschen bereitstellen GPUs Und Arm-basierte CPUs, erweitern die Netzwerkkapazität und integrieren fortschrittliche, die Privatsphäre schützende Computertechniken auf allen Plattformen des Unternehmens.

Ziel der Initiative ist es, die umfangreichen Produktions-Workloads von Meta mit dem Hardware- und Software-Ökosystem von Nvidia zu kombinieren, um Leistung und Effizienz zu optimieren.

Einheitliche Architektur über alle Rechenzentren hinweg

Die beiden Unternehmen schaffen eine einheitliche Infrastrukturarchitektur, die sich über den gesamten Standort erstreckt Rechenzentren und Nvidia-Cloud-Partnerbereitstellungen.

Dieser Ansatz vereinfacht den Betrieb und stellt gleichzeitig skalierbare, leistungsstarke Rechenressourcen für KI-Training und Inferenz bereit.

„Niemand setzt KI in der Größenordnung von Meta ein – die Integration von Pionierforschung mit einer industriellen Infrastruktur, um die weltweit größten Personalisierungs- und Empfehlungssysteme für Milliarden von Benutzern zu betreiben.“ sagte Jensen Huang, Gründer und CEO von Nvidia.

„Durch umfassendes Codesign für CPUs, GPUs, Netzwerke und Software stellen wir den Forschern und Ingenieuren von Meta die vollständige Nvidia-Plattform zur Verfügung, während sie die Grundlage für die nächste KI-Grenze schaffen.“

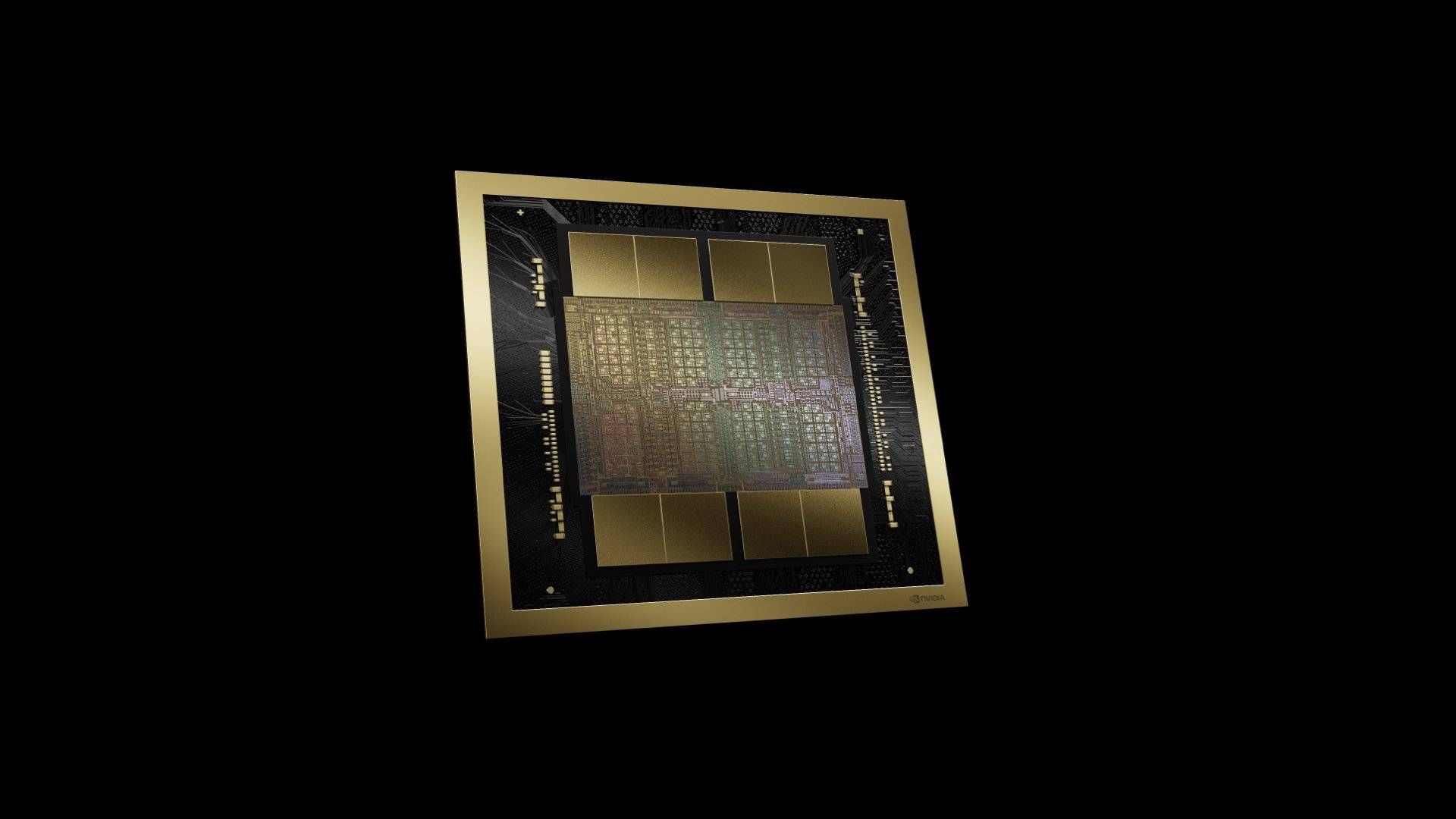

Nvidias GB300-basierte Systeme wird das Rückgrat dieser Einsätze bilden. Sie werden eine Plattform bieten, die Rechenleistung, Speicher und Speicher integriert, um den Anforderungen von KI-Modellen der nächsten Generation gerecht zu werden.

Meta erweitert außerdem die Nvidia Spectrum-X-Ethernet-Netzwerke in seiner gesamten Präsenz und zielt darauf ab, eine vorhersehbare Leistung mit geringer Latenz zu liefern und gleichzeitig die Betriebs- und Energieeffizienz für große Arbeitslasten zu verbessern.

Meta hat mit der Einführung von Nvidia Confidential Computing begonnen, um KI-gestützte Funktionen zu unterstützen WhatsAppwodurch Modelle für maschinelles Lernen die Verarbeitung von Benutzerdaten unter Wahrung von Privatsphäre und Integrität ermöglichen.

Die Zusammenarbeit plant, diesen Ansatz auf andere Meta-Dienste auszuweiten und datenschutzverbesserte KI-Techniken in mehrere Anwendungen zu integrieren.

Die Ingenieursteams von Meta und Nvidia arbeiten eng zusammen, um gemeinsam KI-Modelle zu entwerfen und Software im gesamten Infrastruktur-Stack zu optimieren.

Durch die Abstimmung von Hardware, Software und Workloads wollen die Unternehmen die Leistung pro Watt verbessern und die Schulung für hochmoderne Modelle beschleunigen.

Groß angelegter Einsatz von Nvidia Grace CPUs ist ein zentraler Bestandteil dieser Bemühungen, wobei die Zusammenarbeit den ersten großen Grace-only-Einsatz dieser Größenordnung darstellt.

Softwareoptimierungen in CPU-Ökosystembibliotheken werden ebenfalls implementiert, um den Durchsatz und die Energieeffizienz für aufeinanderfolgende Generationen von KI-Workloads zu verbessern.

„Wir freuen uns, unsere Partnerschaft mit Nvidia auszubauen, um mithilfe der Vera Rubin-Plattform Spitzencluster aufzubauen und jedem auf der Welt persönliche Superintelligenz zu bieten.“ sagte Mark Zuckerberg, Gründer und CEO von Meta.

Folgen Sie TechRadar auf Google News Und Fügen Sie uns als bevorzugte Quelle hinzu um unsere Expertennachrichten, Rezensionen und Meinungen in Ihren Feeds zu erhalten. Klicken Sie unbedingt auf die Schaltfläche „Folgen“!

Und natürlich können Sie das auch Folgen Sie TechRadar auf TikTok für Neuigkeiten, Rezensionen, Unboxings in Videoform und erhalten Sie regelmäßige Updates von uns WhatsApp zu.