KI-Beschleunigungshardware wird immer teurer, da Chips der nächsten Generation hohe Energiebudgets und große Infrastrukturinvestitionen erfordern. Für viele Start-ups und kleinere Unternehmen stellen die Kosten und die Komplexität des Einsatzes von KI in großem Maßstab Hindernisse dar, lange bevor die Softwareentwicklung überhaupt beginnt.

Neue Siliziumanbieter wie FuriosaAI versuchen, diese Gleichung zu überdenken und konzentrieren sich auf Effizienz, Leistung und alternative Ansätze für den GPU-dominierten Markt.

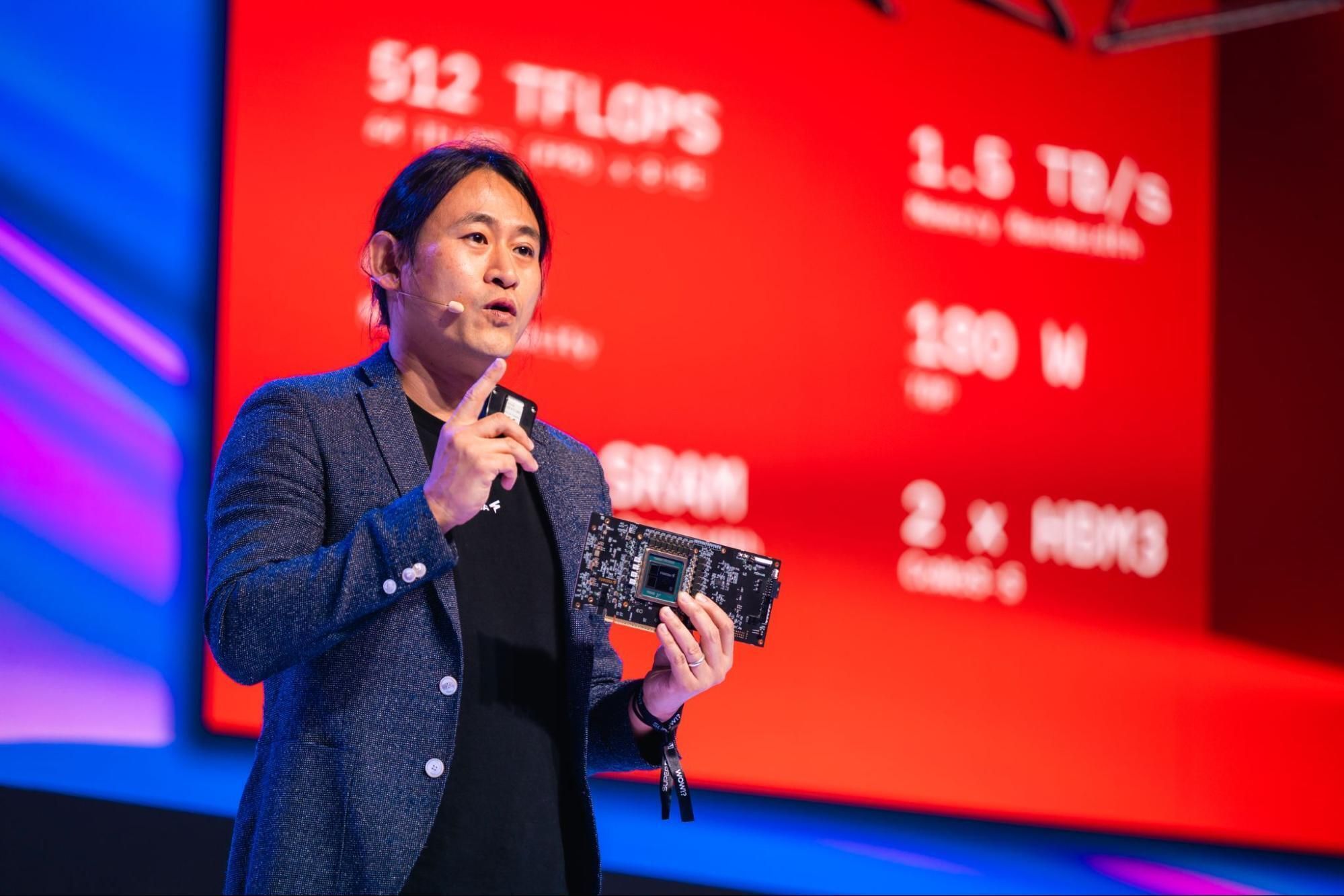

FuriosaAI wurde in Südkorea gegründet und entwickelt KI-Inferenzchips, die eine hohe Leistung liefern und gleichzeitig den Stromverbrauch und die Belastung des Rechenzentrums reduzieren sollen. Sein neuester Prozessor, RNGD, basiert auf der Tensor-Contraction-Prozessor-Architektur des Unternehmens und zielt darauf ab, anspruchsvolle KI-Modelle auszuführen, ohne auf herkömmliche GPU-Frameworks angewiesen zu sein.

- In der Vergangenheit haben Japan und Europa einige großartige Unternehmen hervorgebracht (ST Electronics, NEC usw.). Warum gibt es außerhalb Chinas und der USA so wenige KI-Siliziumanbieter?

Erstens würde ich Ihre Prämisse zumindest leicht in Frage stellen: Nur sehr wenige Hardware-Startups haben jemals gegen Nvidias Dominanz im KI-Bereich vorgegangen. Auch anderthalb Jahrzehnte nach AlexNet stehen wir noch am Anfang dieser Branche. Und einige KI-Hardware-Innovatoren wie Hailo und Axelera sind tatsächlich außerhalb der USA oder Chinas entstanden.

Aus strukturellen Gründen ist die Liste jedoch kurz.

Im Gegensatz zum Krypto-Mining, wo die Algorithmen fest sind und einfache ASICs gut funktionieren, schreitet und entwickelt sich die KI schnell weiter.

Der Bau eines Chips für ein bewegliches Ziel erfordert sowohl Hardware- als auch Compiler-Know-how, das sich tendenziell an Orten mit starker Halbleitertradition häuft. Außerdem gibt es nur wenige Orte auf der Welt, die enge Beziehungen zu Fabs und Chip-Herstellungspartnern haben.

Aus diesem Grund war der Sitz in Südkorea für Furiosa tatsächlich ein Wettbewerbsvorteil.

Wir hatten Zugang zu Talenten aus erstklassigen Ingenieurprogrammen an koreanischen Universitäten und koreanischen Technologiegiganten. Wir konnten auch Partnerschaften mit führenden Unternehmen in Korea (wie SK Hynix, das HBM3 für unseren Chip-Inferenzchip der zweiten Generation, RNGD, bereitstellt) und anderswo in Asien (wie unserem Foundry-Partner TSMC in Taiwan) aufbauen.

Die Entfernung zum Silicon Valley zwang uns auch zu einer sehr disziplinierten Vorgehensweise. Furiosa startete mit nur 1 Million US-Dollar Startkapital und wir verbrachten mehrere Jahre damit, unsere Ideen zu verfeinern, bevor wir Silizium auslieferten.

Wir haben uns voll und ganz unserem auf Tensorkontraktionen basierenden Ansatz verschrieben und konnten die gängige Meinung und den Hype im Valley ignorieren.

Aber Hardware muss auf einem globalen Markt konkurrieren; Wir können nicht nur ein regionaler Anbieter sein. Da wir nun RNGD in großen Mengen versenden, arbeiten wir mit Unternehmenskunden auf der ganzen Welt zusammen.

- Hardware ist nur ein Teil der Gleichung und Nvidia hat Jahre gebraucht, um seinen mittlerweile berüchtigten Software Moat (CUDA) aufzubauen. Was unternimmt Furiosa, um mit seinem gewaltigen Gegner zu konkurrieren?

Der Versuch, die riesige CUDA-Bibliothek von Nvidia zu replizieren, ist eine strategische Sackgasse.

Wir haben einen mutigeren Weg eingeschlagen, indem wir unsere Hardware und Software nach ersten Prinzipien speziell für KI entwickelt haben, sodass wir CUDA nicht neu erstellen mussten.

Unsere Chips nutzen die proprietäre Tensor Contraction Processor (TCP)-Architektur von Furiosa, die die mehrdimensionale Mathematik des Deep Learning nativ ausführt, anstatt sie in die von GPUs verwendeten Legacy-Strukturen zu zwingen.

Dadurch kann unser Compiler Modelle optimieren, ohne dass Tausende von handabgestimmten Kerneln erforderlich sind.

RNGD, das jetzt in Massenproduktion hergestellt wird, zeigt die Vorteile unseres Ansatzes. Es liefert leistungsstarke Inferenzen für die anspruchsvollsten Modelle der Welt und verbraucht dabei nur 180 Watt (im Vergleich zu den 600 Watt oder mehr, die GPUs benötigen).

Globale Partner mögen LG AI Research hat diese bahnbrechende Effizienz in der Produktion bestätigt.

Wir haben auch die Bindung an CUDA durchbrochen, indem wir unseren Software-Stack so aufgebaut haben, dass er sich nahtlos in Standardtools wie PyTorch und vLLM integrieren lässt, sodass Entwickler auf diese Leistung zugreifen können, ohne ihren Workflow zu ändern.

- Nach und nach entwickeln die größten Hyperscaler ihre eigenen KI-Chiplösungen (Google, Microsoft, Amazon), um ihre Abhängigkeit von Dritten zu verringern. Wo passen Furiosa (und andere) in dieses Bild?

Das aktuelle GPU-Paradigma führt zu extremen Energieherausforderungen und Infrastrukturengpässen für die gesamte Branche, einschließlich Hyperscalern. Wir sehen eine Zukunft, die von heterogenem Computing geprägt ist und in der verschiedene Architekturen Seite an Seite arbeiten, um unterschiedliche Anforderungen (z. B. Training vs. Inferenz) am effektivsten zu erfüllen.

Da für uns Gesamtbetriebskosten, Energieeffizienz und Flexibilität im Vordergrund stehen, wird unsere Technologie eine zentrale Rolle bei der Lösung dieses Problems für alle spielen.

Unser Fokus liegt derzeit auf vier spezifischen Sektoren, die die Strom- und Infrastrukturprobleme am stärksten spüren:

● Nationen und regulierte Branchen müssen mit sensiblen Daten vor Ort und nicht in einer öffentlichen Cloud arbeiten. RNGD ermöglicht ihnen die Bereitstellung leistungsstarker Inferenz innerhalb ihrer bestehenden Leistungsbereiche und gewährleistet so die Datensouveränität, ohne dass umfangreiche neue Infrastrukturprojekte erforderlich sind.

● Für Unternehmenskunden stehen die Gesamtbetriebskosten und die Flexibilität an erster Stelle. RNGD passt in standardmäßige luftgekühlte 15-kW-Racks und vermeidet die teure Nachrüstung der Flüssigkeitskühlung, die bei älteren GPUs erforderlich ist, was es zur schnellsten und kostengünstigsten Möglichkeit zur Skalierung macht.

● Regionale und spezialisierte Clouds müssen hinsichtlich der Margen mit den Big 3 konkurrieren. Die hohe Rechendichte von RNGD ermöglicht es CSPs, den Umsatz pro Rack zu maximieren und gleichzeitig die Betriebskosten niedrig zu halten.

● Andere Sektoren wie Telekommunikationsunternehmen arbeiten mit Rechenzentrumsumgebungen mit eingeschränkter Stromversorgung am Netzwerkrand. Die Energieeffizienz von RNGD erfüllt auch ihre Anforderungen.

Unser Chip der nächsten Generation, der sich derzeit in der Entwicklung befindet, wird Hyperscaler direkt neben diesen Schlüsselsektoren ansprechen.

- Wie sehen Sie die Zukunft des Rechenzentrums (Sie besuchen ein Rechenzentrum im Jahr 2036, was sehen Sie darin)?

In 10 Jahren wird „Rechenzentrum“ viele verschiedene Bedeutungen haben, so wie sich „Computer“ mittlerweile auf alles bezieht, von Ihrer Smartwatch bis hin zu einem Hochleistungsserver.

Einige Rechenzentren werden die Art von futuristischem Aufbau sein, den Sie sich vorstellen: riesig und (wahrscheinlich) fusionsbetrieben oder die Erde umkreisend. Aber andere werden klein und übereffizient sein.

Ihr örtliches Krankenhaus verfügt beispielsweise über ein lokales KI-Rechenzentrum, um intelligente Assistenten für Ärzte und Krankenschwestern zu betreiben und so die Latenz niedrig und die Daten lokal und sicher zu halten.

Telekommunikationsunternehmen werden über viele hochleistungsfähige „Edge“-KI-Rechenzentren verfügen, die für sehr niedrige Latenzzeiten optimiert sind.

Ich bin mir sicher, dass die KI-Rechenzentren des Jahres 2036 nicht mit GPUs gefüllt sein werden. Es wird eine Vielzahl von KI-spezifischem Silizium für unterschiedliche Anforderungen geben.

Das liegt zum Teil an der Leistungsineffizienz der GPUs. Grundsätzlich besteht jedoch weitgehende Einigkeit darüber, dass die GPU-Architektur nicht ideal für KI ist.

GPU-Hersteller haben daran gearbeitet, diese Lücke durch Innovationen wie das Hinzufügen von Tensorkernen zu ihren Chips zu schließen, aber letztendlich werden die Vorteile der Umstellung von GPUs auf AI-First-Architekturen zu groß sein, um sie zu ignorieren.

- Ohne zu viele Details zu Ihrer Roadmap zu nennen: Wird Furiosa Silicon dem traditionellen Weg der KI-Produkte folgen?

Unser Fokus liegt jetzt und bei zukünftigen Produkten darauf, das zu liefern, was Unternehmenskunden am meisten benötigen: Hochleistungs-Inferenz für Rechenzentren, die außerdem energieeffizient, kosteneffektiv und einfach bereitzustellen ist, ohne dass große Infrastruktur-Upgrades erforderlich sind.

Das bedeutet, dass Kennzahlen wie Token pro Watt und Token pro Rack für eine höhere Rechendichte priorisiert werden müssen.

Wir werden auch neue Fortschritte in der Branche, wie kleinere Knoten und neue Speichertechnologien, aggressiv nutzen.

Unser Chip der ersten Generation verwendete einen 14-Nanometer-Knoten. Unser RNGD-Chip nutzt HBM3 und einen 5-Nanometer-Knoten und wir werden ihn weiterentwickeln. Aber es ist unsere architektonische Innovation, die es uns ermöglicht, eine bessere und energieeffizientere Leistung zu erzielen als GPUs, die auf demselben Knoten aufgebaut sind.

Eine weitere Sache, die Sie bei unserer Roadmap beachten sollten, ist, dass es sowohl um Software als auch um Hardware geht. Furiosa hat mehr Software-Ingenieure als Hardware-Ingenieure, weil wir weiterhin neue Modelle und Bereitstellungstools schnell und effektiv unterstützen müssen.

Wir haben im Jahr 2025 drei große SDK-Updates veröffentlicht und werden dieses Tempo im Jahr 2026 und darüber hinaus beibehalten.

- Furiosa stammt aus Südkorea. Wie sehen die großen Chaebols (Samsung, LG, Hyundai, SK Hynix) dieses Startup? Welche Partnerschaften bestehen derzeit?

Wir haben mit großen koreanischen Technologieführern sowohl als Partner als auch als Kunden zusammengearbeitet: Samsung Foundry hat unseren Chip der ersten Generation hergestellt, SK Hynix liefert den HBM3-Speicher für RNGD und LG ist ein Flaggschiff-Unternehmenskunde, der derzeit unsere Chips einsetzt. Es sind tiefe Beziehungen, die über viele Jahre hinweg aufgebaut wurden.

Über Konzerne hinaus arbeiten wir mit weltweit wettbewerbsfähigen, in Korea ansässigen KI-Startups wie Upstage zusammen und profitieren von Koreas KI-versierten Verbrauchern und der großen industriellen Basis in der Automobil-, Schiffbau- und anderen Sektoren.

KI ist auch die oberste politische Priorität der koreanischen Regierung. Koreas Präsident hat ehrgeizige Initiativen auf den Weg gebracht, um zu einem globalen KI-Kraftpaket zu werden, wobei KI-Chips im Mittelpunkt stehen.

Wir freuen uns sehr über die Dynamik Koreas im Bereich KI, und dies wird das neue Ökosystem, das wir aufbauen, um die Branche über GPUs hinaus voranzubringen, stärken.

Folgen Sie TechRadar auf Google News Und Fügen Sie uns als bevorzugte Quelle hinzu um unsere Expertennachrichten, Rezensionen und Meinungen in Ihren Feeds zu erhalten. Klicken Sie unbedingt auf die Schaltfläche „Folgen“!

Und natürlich können Sie das auch Folgen Sie TechRadar auf TikTok für Neuigkeiten, Rezensionen, Unboxings in Videoform und erhalten Sie regelmäßige Updates von uns WhatsApp zu.